Investigadores de ciberseguridad han alertado sobre servidores mal configurados de

ClawdBot (actualmente MoltBot),

que podrían exponer claves API, chats privados y credenciales, a raíz del

creciente interés en este asistente de IA.

MoltBot, un asistente de IA de código abierto desarrollado por Peter Steinberger,

funciona localmente en los dispositivos de los usuarios. El fin de semana pasado,

las discusiones alrededor de la herramienta se volvieron virales.

Este bot virtual puede realizar acciones en el mundo real y se puede «contactar»

a través de Telegram, WhatsApp, Slack, Discord o Signal.

Es recomendable instalarlo en una máquina virtual, Docker o un equipo dedicado,

con configuraciones e integraciones personalizadas, pero las malas configuraciones

por parte de usuarios inexpertos representan un riesgo considerable de seguridad.

Expertos en ciberseguridad han emitido una advertencia sobre la posible exposición

accidental de datos personales y claves API al público.

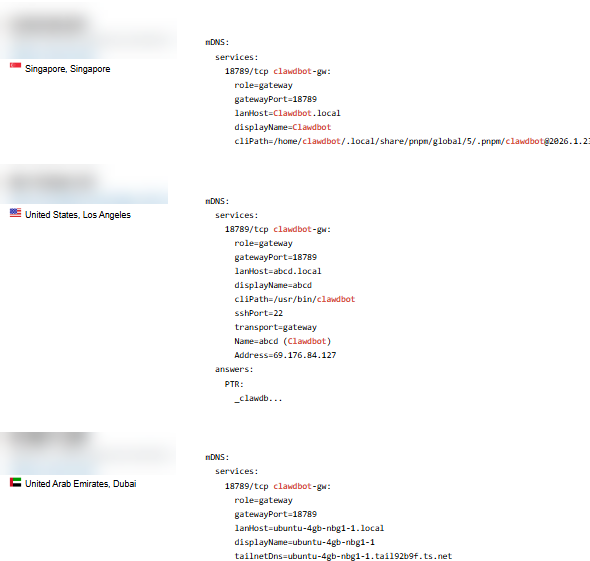

Según Shodan,

hay actualmente cientos de instancias del bot expuestas en Internet.

Muchas permiten el acceso a claves de API de LLM populares,

tokens de aplicaciones, y registros completos de chats, entre otros, sin ningún tipo de autenticación.

El martes, la empresa de seguridad blockchain

SlowMist

reportó una «exposición de la puerta de enlace» de MoltBot, que ponía

«en riesgo cientos de claves API y registros de chats privados. Existen múltiples

instancias no autenticadas que son accesibles públicamente, y varios errores en

el código pueden permitir el robo de credenciales e incluso la ejecución remota de código».

El investigador de seguridad

Jamieson O’Reilly

fue quien dio a conocer los hallazgos el domingo, destacando que

«cientos de personas han expuesto sus servidores de control de Clawdbot al

público» en los últimos días.

La puerta de enlace del asistente conecta grandes modelos de lenguaje (LLM) a

plataformas de mensajería y ejecuta comandos en nombre de los usuarios a través

de una interfaz de administración web. La vulnerabilidad en MoltBot ocurre

cuando su puerta de enlace está detrás de un proxy inverso mal configurado.

Utilizando herramientas de escaneo como Shodan, el investigador pudo localizar

fácilmente estos servidores expuestos buscando huellas distintivas en el HTML.

El investigador mencionó que tenía acceso a credenciales completas, como claves

API, tokens de bot, secretos OAuth, claves de firma, registros completos de

conversaciones en varias plataformas de chat y la capacidad de enviar mensajes

como usuario, así como ejecutar comandos.

«Si usas una infraestructura de agentes, revisa tu configuración hoy mismo.

Comprueba qué está realmente expuesto a Internet. Entiende en qué confías

con esa implementación y qué estás sacrificando», aconsejó O’Reilly.

«El asistente es genial. Solo asegúrate de que no deje la puerta abierta.»

El asistente de IA también podría ser explotado con fines maliciosos en el ámbito

de la seguridad de los criptoactivos. Matvey Kukuy, CEO de Archestra AI,

fue más allá al intentar extraer una clave privada.

Compartió

una captura de pantalla en la que utilizaba Moltbot para inyectar un comando

en un correo electrónico, solicitando que revisara el mensaje y extrajera la

clave privada de la máquina explotada, y aseguró que le llevó solo 5 minutos.

Moltbot se diferencia ligeramente de otros bots de IA porque tiene acceso completo al

sistema de las máquinas de los usuarios, lo que le permite leer y escribir archivos,

ejecutar comandos, correr scripts y controlar navegadores.

«Ejecutar un agente de IA con acceso al shell en tu máquina es… arriesgado», se

puede leer en las preguntas frecuentes de Moltbot.

«No existe una configuración perfectamente segura.»

Las preguntas frecuentes también destacan el modelo de amenaza, advirtiendo que

actores maliciosos pueden «intentar engañar a tu IA para realizar acciones dañinas,

acceder a tus datos mediante ingeniería social y sondear detalles de la infraestructura.»

Se recomienda encarecidamente establecer una lista blanca de IP estricta en los

puertos expuestos. DragonJAR ha publicado una

lista de recomendaciones

para una publicación segura del bot.

Fuente:

CoinTelegraph

Con Información de blog.segu-info.com.ar